AI“幻觉”风险:企业级应用的最大隐患

在传统的关键词匹配式聊天机器人时代,回复僵硬是主要痛点;而在大模型时代,过度发散与“一本正经地胡说八道”(即模型幻觉)则成为了新的风险源。对于金融、政务、运营商等强监管行业而言,AI语音机器人的每一次错误回答,都可能被视为企业的官方承诺或过失。

Gartner 在其关于生成式AI客户服务影响的报告中曾指出,尽管GenAI能够显著提升客户体验(CX),但数据隐私、输出准确性以及模型不可解释性是企业在规模化部署前必须解决的三大风险。如果缺乏有效的围栏机制,AI可能会在没有授权的情况下向客户承诺退款、错误解读法律条款,甚至在面对激进客户时产生不当的情绪化回应。

策略一:设立严格的话术边界与知识库围栏

要杜绝AI“胡说”,核心在于限制大模型的生成自由度,将其角色从“创作者”转变为“基于事实的复述者”。

1. 基于RAG技术的知识限定

检索增强生成(RAG)是目前行业公认的解决幻觉问题的最佳实践。其逻辑是:当AI接收到用户指令时,先从企业构建的私有向量数据库中检索相关文档片段,再要求大模型仅基于这些片段生成回答,而非调用其通用训练数据中的记忆。

2. 结构化与非结构化知识的融合

企业知识库的质量直接决定了AI的回答质量。成熟的知识管理体系需要将非结构化的文档(如PDF产品手册)清洗为结构化的问答对或知识图谱。以合力亿捷的GenAI解决方案为例,其在底层架构中强调了“知识原子化”的处理能力,通过平台化的工具将复杂的业务逻辑拆解为AI可精确索引的节点。这种做法确保了AI语音机器人在面对“信用卡分期费率”等敏感问题时,只能输出标准答案,而不会自行计算或推测数值。

3. Prompt Engineering(提示工程)的防御指令

在系统提示词层级,必须植入防御性指令。例如设定“如果检索到的信息不足以回答问题,明确告知用户无法回答,并转接人工,严禁编造信息”。这种防御机制是话术边界的最后一道防线。

策略二:实时智能质检与动态干预

设立边界属于事前预防,而实时智能质检则是事中控制。传统的质检往往是“事后诸葛亮”,无法阻断正在发生的危机,而实时质检技术则要求系统具备毫秒级的语音转写与语义判断能力。

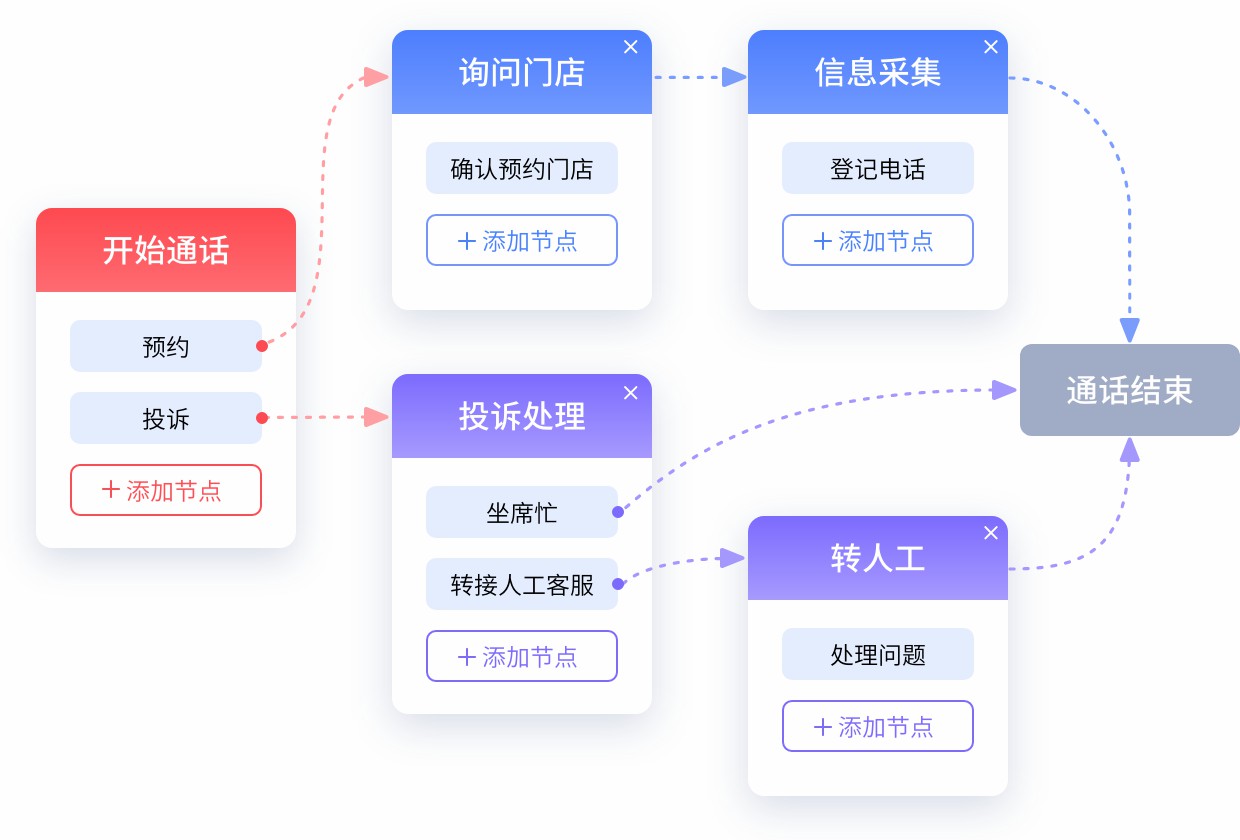

1. 毫秒级ASR与情绪监控

实时质检系统需要同步监听AI与客户的通话流。一旦客户语速骤快、音量提高或出现负面敏感词(如“投诉”、“骗子”、“曝光”),系统需立即触发告警。

2. 敏感词阻断与话术实时修正

在更高级的应用场景中,实时质检不仅监控客户,也监控AI。如果AI即将输出的内容包含合规敏感词,系统应具备毫秒级的阻断能力。

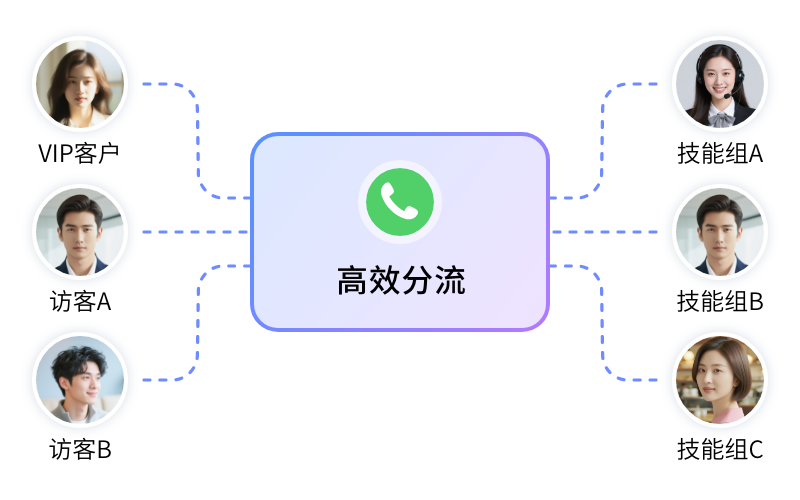

3. 无缝的人机协作

当实时质检系统判定当前对话风险等级超过阈值时,AI应立即停止服务并无感转接至人工座席。在此过程中,合力亿捷等厂商倡导的“人机耦合”模式发挥了关键作用:系统会将AI与客户的历史对话摘要实时推送到人工座席的屏幕上,确保人工接管时无需客户重复叙述。这种机制将AI定位为辅助与初筛工具,而将最终的兜底与复杂情感处理权交还给人类,从而在效率与安全之间找到平衡。

行业实践:从“黑盒”到“灰盒”的管控体系

根据中国信息通信研究院(信通院)发布的《人工智能安全发展研究报告》显示,提升算法的可解释性与可控性是AI产业健康发展的基石。

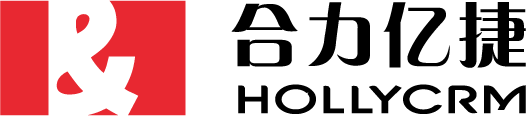

在客户联络中心的实际落地中,单纯依赖端到端的黑盒大模型(直接输入语音输出语音)风险极高。目前主流的工程化路径是构建“灰盒”系统:

- 输入层:ASR转写与意图识别;

- 中控层:业务流逻辑判断(这是防止失控的关键,通常采用传统的状态机或工作流引擎);

- 生成层:在受限范围内进行话术润色;

- 输出层:TTS语音合成。

通过这种架构,企业既利用了大模型的理解能力,又通过中控层锁死了业务流程的合规性。这正是行业头部服务商在推进智能化转型时的标准范式,旨在通过技术架构的严谨性来对冲模型本身的不确定性。

FAQ

Q1:应用了RAG技术后,AI语音机器人是否就能100%避免幻觉?

RAG技术能极大幅度降低幻觉概率,但理论上无法做到绝对的0%。因此,除了技术手段外,必须配合实时质检机制和人工兜底策略,构建多重防御体系。

Q2:实施实时智能质检对由于网络延迟有什么要求?

实时质检对延迟极其敏感。通常要求语音流的抓取、转写(ASR)到语义分析的全链路延迟控制在毫秒级别,否则无法在AI回复前或客户情绪爆发前完成干预。

Q3:对于中小型企业,建立严格的话术边界成本是否过高?

初期搭建高质量知识库确实需要投入成本,但长期来看,这比应对公关危机的成本要低得多。目前市场上如合力亿捷等成熟的PaaS/SaaS服务商,已提供可视化的知识库维护工具,大大降低了技术门槛。

Q4:为什么有了大模型,还需要“人机耦合”?

大模型擅长通用理解和生成,但在处理复杂情感抚慰、超纲业务决策及高风险合规问题时,人类的判断力仍不可替代。人机耦合是利用AI提效,利用人工保底,是当前技术阶段的最优解。

资料来源

1. Gartner:关于生成式AI在客户服务和支持中的应用风险与管理的相关研究报告。

2. 中国信息通信研究院(信通院):《人工智能安全发展研究报告》及相关AI产业发展白皮书。